На конференции IBC, состоявшейся на прошлой неделе, Adobe продемонстрировала Character Animator 2019 с функцией Style Transfer, которая способна в автоматическом режиме создавать анимацию. Об этом пишет fxguide.

Дейв Симонс, один из создателей Cosa — разработчика After Effects, который впоследствии был выкуплен Adobe — в 2007 году перешел в команду продакт-девелопмента. Его команде было поручено перенести исследования из лаборатории на продукты. «В основном мы пытались перенести технологию в After Effects и Premiere, — объясняет он. — Character Animator поначалу не входил в область наших экспериментов, потому что и без этого мы делали много вещей. Но потом мы попробовали пойти в сторону Character — и нас ждал большой успех».

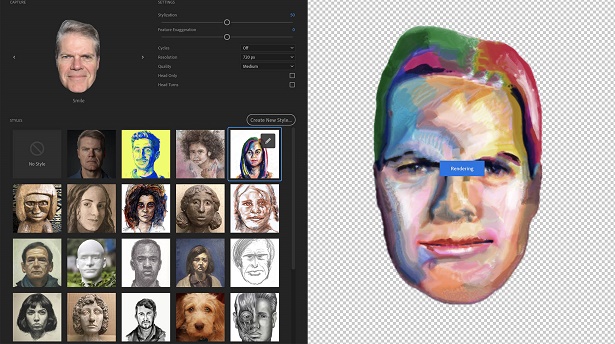

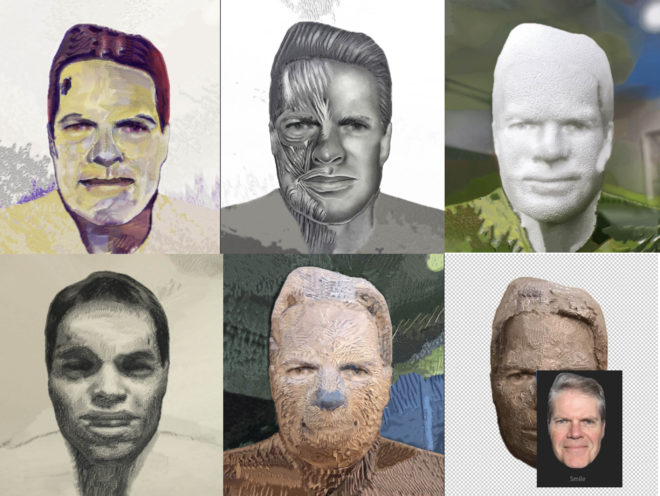

Команда Симонса перешла на полноценную работу с Character Animator, результатом которой стала новая функция — Style Transfer.

Технология переноса стиля лица берёт свое начало в некоторых исследованиях — например, в статье Example-based Synthesis of Stylized Facial Animation, которое Adobe Research опубликовала в июле 2017 года. Основой послужила кандидатская диссертация Якуба Фишера из Чешского национального технического университета. «Мы наняли Якуба так быстро, как только смогли, чтобы он мог продолжить свою впечатляющую работу в Adobe», — прокомментировал Симонс.

Технология выглядит так, словно использует машинное обучение, но на самом деле это не так. «Сама передача стиля не использует глубокое обучение, но мы используем его на некоторых этапах предварительной обработки. Style transfer и Content Aware Fill используют один и тот же компонент PatchMatch, но в то время как Content Aware Fill работает только с изображением, в Style transfer много скрытых «изображений» (масок, сегментов и т. д.), которые направляют передачу», объясняет Якуб Фишер.

Ниже представлено видео от fxguide, где объясняется работа нового инструмента.

Применение вне Character Animator

Безусловно, технология Style transfer создана для работы в Character Animator, но алгоритмический подход можно было использовать на любом видео, например, в Premiere или After Effects. При таком подходе необходимо будет использовать функцию обучения для искусственного интеллекта, чтобы выделить, идентифицировать и сегментировать целевые объекты. Очевидно, что это будет автономный процесс из-за длительного времени рендеринга. У Adobe пока нет планов использовать эту технологию вне Character Animator (в ближайшем будущем), но она провела тестирование на видео, и это может сработать.

«Учитывая то, как работает технология — благодаря направляющим каналам — не составит большого труда расширить количество объектов и усложнить задачу», — слова Дейва Симонса звучат обнадеживающе.

Читайте также:

Adobe продемонстрировала новый инструмент, который войдёт в Photoshop CC 2019

Нейросеть научилась подделывать видео

Adobe использует ИИ для обнаружения ретушированных изображений