Одна из главных проблем сервис потоковой передачи музыки – ненормативная лексика. По правилам сервисы должны ограничивать детей от песен с неприемлемыми текстами. С другой стороны, как проверить миллионы песен?

Сервис потоковой передачи музыки Deezer нашел новый способ искать нецензурную лексику. Компания разработала технику на основе искусственного интеллекта, которая автоматически обнаруживает запрещенный контент – просто анализируя звук.

Конечно, человек тоже может проделать такую работу. Но это нелегко, особенно когда дело касается песен ганста-рэперов вроде NWA. Комик Адам Бакстон наглядно показал, как сложно бороться с нецензурными текстами. Чтобы понять, что изменил Адам, найдите NWA – Fuk da police.

Еще одна проблема: звукозаписывающие компании не всегда так прилежны, как Бакстон. В Deezer объясняют, что не могут доверять лейблам полностью.

«Если тег «Ненормативная лексика» не указан, это может означать, что песня подходит для любой аудитории. Но иногда это означает другое: на стороне лейбла не проверили и не приняли решения о нецензурности трека. Большая часть нашего каталога подпадает под эту категорию», – пишет исследователь Deezer Мануэль Муссаллам в своем блоге.

Существующие методы машинного обучения могут найти оскорбительные тексты, ища слова, которые помечены как оскорбительные. Но для этого нужны детально прописанные транскрипты – их тяжело найти, особенно для новых синглов.

Один из альтернативных подходов – использование нейронных сетей, которые доказали свое умение классифицировать изображения, тексты, видео и музыку. Но системы используют сложные функции обработки, которые трудно интерпретировать. Эти проблемы побудили Deezer попробовать новый подход.

В поисках нецензурных текстов

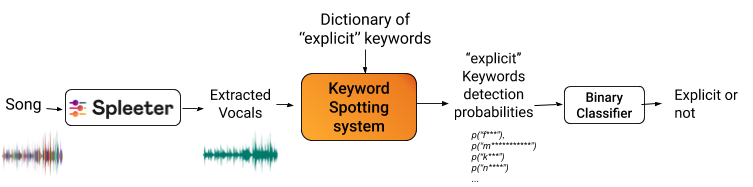

Компания использует инструмент Spleeter для извлечения вокала из песен, а затем прогоняет текст через систему определения ключевых слов, которая помечает потенциально оскорбительные слова. Дальше – знакомый бинарный классификатор: он делит текст на «допустимый» и «нецензурный».

В тестах система превзошла работу модели черного ящика – метод, при котором известны входные данные и результат, но непонятно, как система это добивается. Как «черный ящик» использовали те самые нейросети, принцип работы которых трудно интерпретировать. В случае с новым инструментом у Deezer есть четкий ответ, почему эта песня попала в список explicit.

Новый инструмент – доказательство того, что вам не всегда приходится жертвовать объяснимостью ради точности. Но результаты пока не так хороши, как если бы каждую песню проверял человек вручную. Тем не менее, Мануэль Муссаллам доволен даже таким первым шагом в правильном направлении:

«Наш подход позволит не только обнаружить наличие матерных слов, но и узнать, где они встречаются в песне. Так мы можем выделить некоторые части аудио для аннотатора, чтобы облегчить его задачу. В более широком плане, наша цель – получить знания о миллионах песен и использовать их для улучшения продукта Deezer».

Фото на главной: Jonathan Borba

Читайте также:

Фриланс-платформа Fiverr создала нейросеть, которая делает 12 логотипов за минуту